Dalam bidang pembelajaran mesin (machine learning), ada banyak teknik yang digunakan untuk menjelaskan dan memahami prediksi yang dihasilkan oleh model.

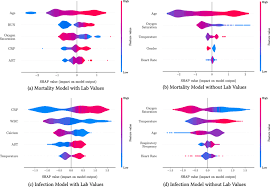

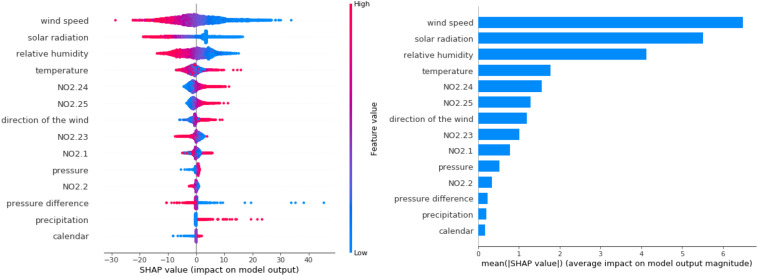

Salah satu teknik yang semakin populer adalah “SHapley Additive exPlanations” (SHAP). SHAP adalah kerangka kerja yang digunakan untuk mengukur kontribusi setiap fitur atau atribut dalam membuat prediksi suatu model.

Mari kita jelajahi lebih lanjut tentang arti dan penggunaan “SHapley Additive exPlanations” dalam konteks pembelajaran mesin.

Definisi Shap

“SHapley Additive exPlanations” (SHAP) mengacu pada pendekatan dalam pembelajaran mesin yang bertujuan untuk memberikan penjelasan yang lebih interpretatif dan intuitif tentang bagaimana setiap fitur atau atribut mempengaruhi hasil prediksi dari suatu model.

Teknik ini memanfaatkan konsep matematika yang dikenal sebagai “nilai Shapley” yang digunakan dalam teori permainan untuk membagi kontribusi atau nilai kolaboratif di antara pemain dalam sebuah permainan kooperatif.

Dalam konteks SHAP, nilai Shapley diterapkan pada atribut atau fitur yang digunakan dalam model. Nilai Shapley mengukur kontribusi relatif setiap fitur terhadap prediksi yang dihasilkan oleh model.

Dengan demikian, SHAP memberikan pemahaman yang lebih mendalam tentang bagaimana dan seberapa banyak setiap fitur berkontribusi dalam membuat keputusan prediksi.

Contoh Penerapan Shap

Berikut adalah beberapa contoh penerapannya:

Interpretabilitas Model

SHAP dapat digunakan untuk memberikan pemahaman yang lebih dalam tentang bagaimana setiap fitur mempengaruhi hasil prediksi suatu model.

Dengan menganalisis kontribusi relatif dari setiap fitur, kita dapat mengidentifikasi fitur-fitur yang paling penting atau berkontribusi signifikan dalam pembuatan keputusan.

Hal ini membantu kita memahami alasan di balik prediksi model dan memberikan interpretabilitas yang lebih baik.

Feature Selection

Dengan menggunakan SHAP, kita dapat melakukan seleksi fitur yang lebih cerdas. Dalam banyak kasus, terdapat banyak fitur yang digunakan dalam pembuatan model, dan tidak semua fitur memiliki kontribusi yang signifikan terhadap hasil prediksi.

Dengan menganalisis kontribusi SHAP, kita dapat mengidentifikasi fitur-fitur yang kurang penting dan menghapusnya dari model, yang pada gilirannya dapat mengurangi kompleksitas dan meningkatkan kinerja model.

Deteksi Bias dan Diskriminasi

SHAP juga dapat digunakan untuk mendeteksi dan mengatasi bias dan diskriminasi dalam model pembelajaran mesin.

Dengan menganalisis kontribusi SHAP pada tingkat individu atau kelompok, kita dapat mengidentifikasi fitur-fitur yang mungkin menyebabkan bias atau diskriminasi dalam hasil prediksi.

Hal ini memungkinkan kita untuk memperbaiki model dan mengurangi efek negatif yang tidak diinginkan.

Penyampaian Penjelasan yang Berbasis Bukti

Dalam beberapa kasus, hanya memberikan hasil prediksi tanpa penjelasan yang memadai dapat menyebabkan ketidakpercayaan atau kekurangpahaman dari pengguna atau pemangku kepentingan.

Dengan menggunakan SHAP, kita dapat menyediakan penjelasan berbasis bukti yang terperinci tentang bagaimana setiap fitur mempengaruhi hasil prediksi. Ini membantu meningkatkan transparansi dan kepercayaan terhadap model.

Penelitian dan Pengembangan Model

SHAP juga digunakan dalam penelitian dan pengembangan model. Dengan menganalisis kontribusi SHAP dari model yang sedang dikembangkan, kita dapat memahami dan menguji pengaruh setiap fitur dalam berbagai skenario dan konfigurasi model.

Ini membantu dalam mengoptimalkan model dan memperbaiki kinerjanya. Dalam konteks pembelajaran mesin, SHAP membantu dalam memberikan pemahaman yang lebih mendalam tentang kontribusi relatif dari setiap fitur atau atribut dalam membuat keputusan prediksi.

Dengan menggunakan SHAP, kita dapat mengidentifikasi fitur yang paling penting atau berkontribusi signifikan dalam sebuah model.

Hal ini memberikan dasar interpretatif dan intuitif yang lebih baik dalam pengambilan keputusan berbasis model. Penting untuk dicatat bahwa penggunaan SHAP membutuhkan pemahaman tentang dasar matematika dan konsep nilai Shapley.

Selain itu, interpretasi hasil SHAP juga perlu dianalisis secara kontekstual dan dengan mempertimbangkan pengetahuan domain yang relevan.

Secara keseluruhan, “SHapley Additive exPlanations” (SHAP) adalah kerangka kerja dalam pembelajaran mesin yang digunakan untuk mengukur kontribusi setiap fitur atau atribut dalam membuat prediksi suatu model.

SHAP memberikan penjelasan yang lebih interpretatif dan intuitif tentang kontribusi setiap fitur dalam konteks pembelajaran mesin.

Dengan menggunakan SHAP, kita dapat memahami lebih baik faktor-faktor yang mempengaruhi prediksi dan mengidentifikasi fitur yang paling penting dalam model.

Originally posted 2023-08-10 19:18:28.